新書推薦:

《

我们身边的小鸟朋友:手绘观鸟笔记

》

售價:NT$

356.0

《

拯救免疫失衡

》

售價:NT$

254.0

《

收尸人

》

售價:NT$

332.0

《

大模型应用开发:RAG入门与实战

》

售價:NT$

407.0

《

不挨饿快速瘦的减脂餐

》

售價:NT$

305.0

《

形而上学与存在论之间:费希特知识学研究(守望者)(德国古典哲学研究译丛)

》

售價:NT$

504.0

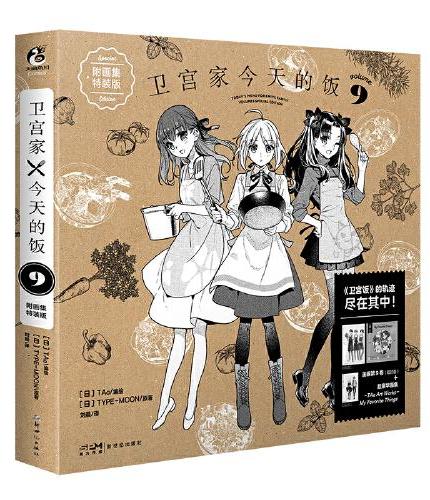

《

卫宫家今天的饭9 附画集特装版(含漫画1本+画集1本+卫宫士郎购物清单2张+特制相卡1张)

》

售價:NT$

602.0

《

化妆品学原理

》

售價:NT$

254.0

|

| 編輯推薦: |

|

1. 全书紧扣任务需求展开,不堆积知识点2. 随书附带源代码,方便读者系统学习并动手实践3. 案例丰富4. 配有微课视频 学习更方便 5. 大数据分析与应用1+X证书配套教材

|

| 內容簡介: |

|

本书以任务为导向,较为全面地介绍了不同场景下Python爬取网络数据的方法。全书共分为7个项目,第1个项目介绍了爬虫与反爬虫的基本概念,以及Python爬虫环境的配置,第2个项目介绍了爬取过程中涉及的网页前端基础知识,第3个项目介绍了在静态网页中爬取数据的过程,第4个项目介绍了在动态网页中爬取数据的过程,第5个项目介绍了对登录后才能访问的网页进行模拟登录的方法,第6个项目介绍了爬取PC客户端、App的数据的方法,第7个项目介绍了使用Scrapy爬虫框架爬取数据的过程。本书所有章节都包含了实训与课后习题,通过练习和操作实战,可帮助读者巩固所学的内容。 本书可以作为大数据技术爱好者的自学用书,也可作为高校大数据技术类专业的教材。

|

| 關於作者: |

|

张良均 高级信息系统项目管理师,泰迪杯全国大学生数据挖掘竞赛(www.tipdm.org)的发起人。华南师范大学、广东工业大学兼职教授,广东省工业与应用数学学会理事。兼有大型高科技企业和高校的工作经历,主要从事大数据挖掘及其应用的策划、研发及咨询培训。全国计算机技术与软件专业技术资格(水平)考试继续教育和CDA数据分析师培训讲师。发表数据挖掘相关论文数二十余篇,已取得国家发明专利12项,主编图书《神经网络实用教程》、《数据挖掘:实用案例分析》、《MATLAB数据分析与挖掘实战》等9本畅销图书,主持并完成科技项目9项。获得SAS、SPSS数据挖掘认证及Hadoop开发工程师证书,具有电力、电信、银行、制造企业、电子商务和电子政务的项目经验和行业背景。

|

| 目錄:

|

|

目录项目1 了解爬虫与Python爬虫环境 1【项目背景】 1【学习目标】 1【思维导图】 2任务1.1 认识爬虫 21.1.1 爬虫的概念 31.1.2 爬虫的原理 31.1.3 爬虫的合法性与robots协议 5任务1.2 认识反爬虫 71.2.1 网站反爬虫的目的与手段 81.2.2 爬取策略制定 9任务1.3 配置Python爬虫环境 101.3.1 配置PyCharm 111.3.2 Python爬虫相关库介绍与配置 201.3.3 配置MySQL数据库 211.3.4 配置MongoDB数据库 34小结 40实训 Python爬虫环境配置 41思考题 42课后习题 42项目2 爬虫基础知识准备 44【项目背景】 44【学习目标】 44【思维导图】 45任务2.1 认识网页基础 462.1.1 了解网页开发技术 472.1.2 了解网页的结构 492.1.3 了解网页的分类 562.1.4 了解网页的数据结构 59任务2.2 认识HTTP 612.2.1 熟悉HTTP请求方法与过程 622.2.2 熟悉常见HTTP状态码 642.2.3 熟悉HTTP头部信息 652.2.4 熟悉Cookie 71小结 73实训 74实训1 创建一个简单的网页文件 74实训2 访问网站并查看请求和响应信息 74思考题 75课后习题 75项目3 简单静态网页爬取—获取某企业官网基本信息 77【项目背景】 77【学习目标】 77【思维导图】 78任务3.1 实现HTTP请求 793.1.1 使用Chrome开发者工具查看网页 803.1.2 使用urllib 3库实现 863.1.3 使用Requests库实现 90任务3.2 解析网页 953.2.1 使用Xpath解析网页 953.2.2 使用Beautiful Soup库解析网页 1013.2.3 使用正则表达式解析网页 109任务3.3 数据存储 1133.3.1 将数据存储为JSON文件 1133.3.2 将数据存储到MySQL数据库 115小结 117实训 118实训1 生成GET请求并获取指定网页内容 118实训2 搜索目标节点并提取文本内容 119实训3 在数据库中建立新表并导入数据 119思考题 120课后习题 120项目4 爬取动态网页——获取图书基本信息 123【项目背景】 123【学习目标】 123【思维导图】 124任务4.1 逆向分析爬取动态网页 1244.1.1 判别网页类型 1254.1.2 获取动态网页信息 126任务4.2 使用Selenium库爬取动态网页 1294.2.1 安装Selenium库及下载浏览器驱动 1304.2.2 打开浏览对象并访问页面 1314.2.3 元素选取 1324.2.4 元素交互 1364.2.5 页面操作 1384.2.6 页面等待 140任务4.3 存储数据至MongoDB数据库 1434.3.1 MongoDB数据库和MySQL数据库的区别 1434.3.2 将数据存储到MongoDB数据库 144小结 148实训 149实训1 生成GET请求并获取指定网页内容 149实训2 搜索目标节点并提取文本内容 149思考题 150课后习题 150项目5 模拟登录—登录某企业官网 153【项目背景】 153【学习目标】 153【思维导图】 154任务5.1 使用表单登录方法实现模拟登录 1555.1.1 查找提交入口 1555.1.2 查找并获取需要提交的表单数据 1585.1.3 使用POST请求方法登录 162任务5.2 使用Cookie登录方法实现模拟登录 1655.2.1 使用浏览器Cookie登录 1655.2.2 基于表单登录的Cookie登录 168小结 170实训 171实训1 使用表单登录方法模拟登录古诗文网 171实训2 使用浏览器Cookie模拟登录古诗文网 171实训3 基于表单登录后的Cookie模拟登录古诗文网 172思考题 173课后习题 173项目6 终端协议分析——获取某音乐PC客户端和APP数据 175【项目背景】 175【学习目标】 176【思维导图】 176任务6.1 分析PC客户端抓包 1776.1.1 了解HTTP Analyzer工具 1776.1.2 爬取酷我音乐PC客户端数据 180任务6.2 分析App抓包 1826.2.1 了解Fiddler工具 1826.2.2 分析酷我音乐App 186小结 189实训 189实训1 抓取酷我音乐PC客户端的推荐歌曲信息 189实训2 监控朴朴超市商品实时价格 191思考题 192课后习题 193项目7 使用Scrapy爬虫——爬取某企业官网新闻动态 194【项目背景】 194【学习目标】 194【思维导图】 195任务7.1 认识Scrapy 1967.1.1 了解Scrapy爬虫框架 1967.1.2 熟悉Scrapy常用命令 198任务7.2 通过Scrapy爬取文本信息 1997.2.1 创建Scrapy爬虫项目 2007.2.2 修改items/pipelines脚本 2017.2.3 编写spider脚本 2047.2.4 修改settings脚本 209任务7.3 定制中间件 2127.3.1 定制下载器中间件 2127.3.2 定制Spider中间件 216小结 217实训 218实训1 爬取“http://www.tipdm.org”的所有新闻动态 218实训2 定制BdRaceNews爬虫项目的中间件 219实训3 爬取猫眼电影“https://maoyan.com/board/4”的影片信息 220实训4 配置Maoyan100爬虫项目的设置文件 220思考题 221课后习题 222

|

|